18 октября, 2024

Короткий хайнаньский парадайз и вперёд по Китаю.

Рассказы о летней Камчатке ещё не закончены, но перенесёмся на пару месяцев вперед, то есть в октябрь-2024.

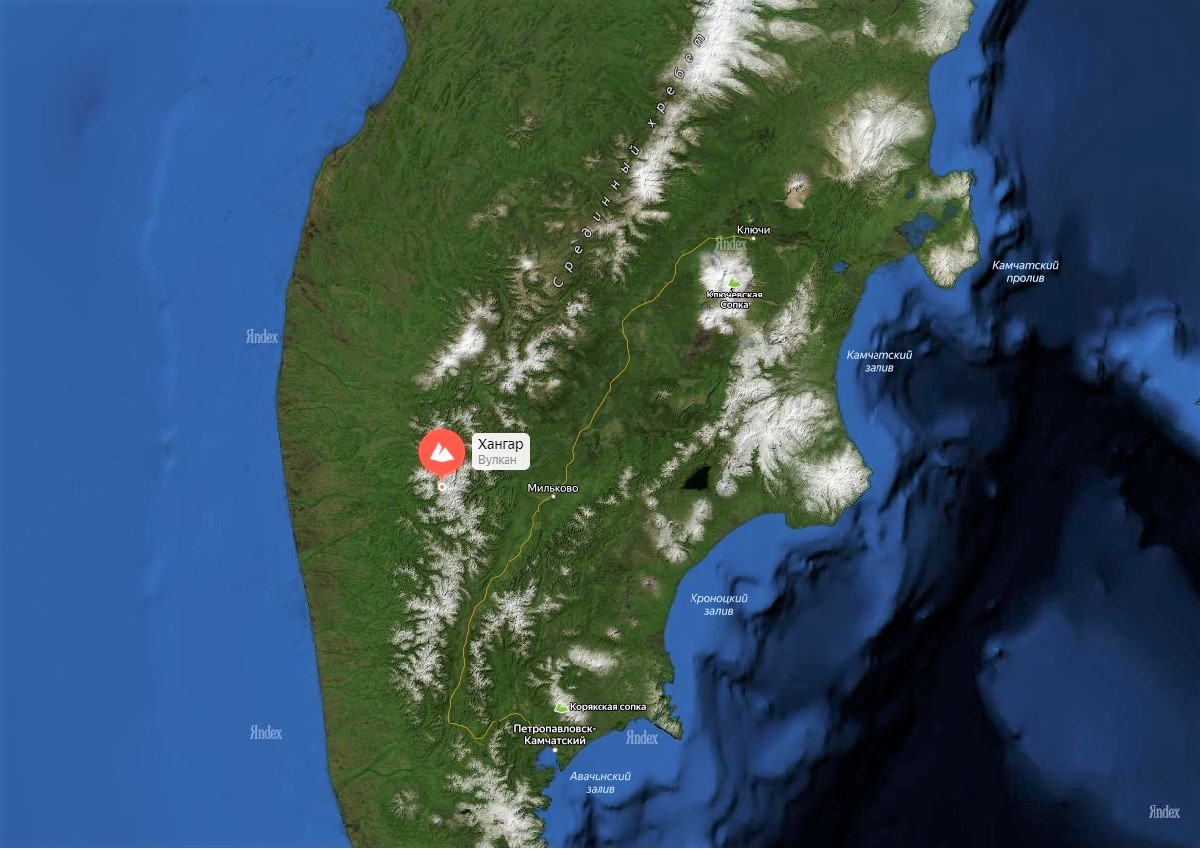

На свой 59-й день рождения я спрятался в Санье – китайском курорте на тропическом острове Хайнань. Но можно было просто сказать «китайский курорт», так как кроме Саньи у них в таком масштабе ничего «пляжно-съедобного» вроде бы и нет. Это самый-самый юг Китая, и до Вьетнама здесь километров 250-300 по морю, тогда как до далекого Пекина – 2500 км, чуть больше, чем от Москвы до Нового Уренгоя и чуть меньше, чем от Сантьяго до Сан-Паулу. В общем, столько же, сколько от Тикси до Петропавловска-Камчатского. То есть не ближний свет.